Ein Funken künstlicher Menschlichkeit

Was sich gehört und was nicht. Die Spielregeln dafür verhandelt jede Gesellschaft für und mit sich aus. Meist geschieht das in einem langsamen Reibungsprozess, an dem sich alle beteiligen – bewusst oder unbewusst. Die Normen, die dabei entstehen, sind immer ein Kind ihrer jeweiligen Zeit. Wenn wir über die Leitkultur debattieren, die Höhe der Mindestsicherung diskutieren, auf Modetrends aufspringen oder über das Gendern streiten: Wir feilen ständig am kollektiven Selbstverständnis von Morgen.

Neben diesen sozialen Normen verhandeln wir aktuell verlässliche Spielregeln für den digitalen Raum. Dabei geht es längst nicht mehr um bloße Netiquette. Wir handeln aus, wo und wie weit Künstliche Intelligenz in das Leben von Menschen hineinragen darf. Soziale Normen reichen da kaum, hier entstehen weltweit für Wirtschaft, Forschung und Medien verbindliche Regelungen.

Mit August ist in der EU die global erste umfassende KI-Verordnung in Kraft getreten. Der sogenannte Artificial Intelligence Act, kurz KI-Act, soll den Einsatz lernender digitaler Systeme schärfer und vor allem einheitlich reguliert. Der Grundgedanke dahinter: Grundrechte, Demokratie und Rechtsstaatlichkeit sollen besser geschützt werden.

Präzises künstliches Auge

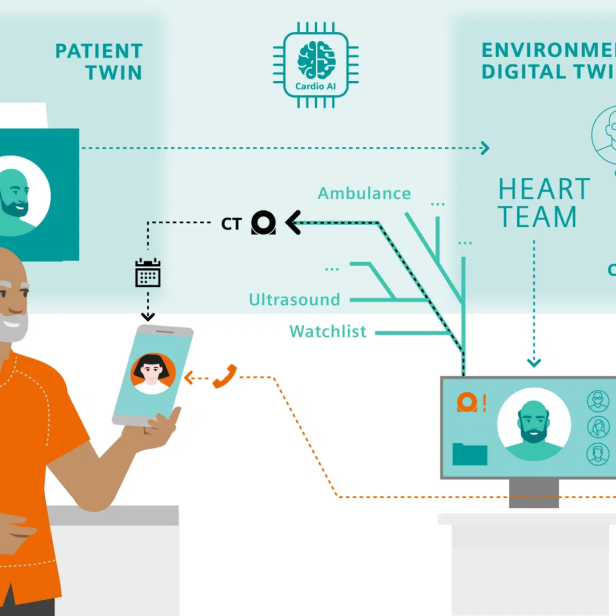

Was hier genau geregelt werden soll, ist komplex. Es geht um den Einsatz von Anwendungen, die auf Basis maschinellen Lernens große Datenmengen durchforstet und daraus bestimmte Schlussfolgerungen zieht. Der Einsatzbereich ist riesig – von Modellen, die in der medizinischen Diagnostik bei der Krebs-Früherkennung das menschliche Auge an Präzision übertreffen über Chatbots, die individuelle Musik-Playlists erstellen bis hin zu Versuchen, mit selbstfahrenden Autos ethisch vertretbare Entscheidungen im Straßenverkehr zu treffen.

Es ist davon auszugehen, dass KI-Systeme künftig in immer mehr Lebensbereiche hineinragen. Der KI-Act zielt daher darauf ab, dass diese Anwendungen möglichst transparent, nicht diskriminierend und nachhaltig sind. Zudem soll am Ende der Kontrollkette ein Mensch stehen – und nicht nur eine andere Technologie. So weit so sinnvoll.

Digitaler Wertekanon

Doch wie regelt man so unterschiedliche Bereiche einheitlich? Die Expert:innen der EU haben sich entschieden, KI-Anwendungen in verschiedene Risikostufen einzuteilen: Systeme, die in kritischer Infrastruktur oder im Bildungs- und Gesundheitswesen eingesetzt werden, müssen strengere Auflagen erfüllen. Was für alle gilt: Anwendungen, die gegen den Wertekanon der EU verstoßen, werden ganz verboten – darunter fällt etwa das in China gängige „Social Scoring“, bei dem soziales Verhalten bewertet und kategorisiert wird.

Zusammenfassen lassen sich all diese Regelungen am ehesten als digitaler Verbraucherschutz, zielen sie doch darauf ab, User:innen vor risikoreichen KI-Anwendungen zu schützen. Österreich und alle anderen EU-Mitgliedstaaten haben nun zwei Jahre Zeit, um diese Verordnung in nationales Recht zu gießen beziehungsweise die nötigen bürokratischen Strukturen - wie etwa eine Art KI-Behörde - zu schaffen.

Das Verbot von KI-Systemen mit „unannehmbarem Risiko“ gilt bereits seit einem halben Jahr. Es betrifft Systeme, die als Bedrohung für Menschen eingestuft werden. Ein konkreter Verhaltenskodex für Anbieter von nach wie vor boomenden KI-Modellen soll bis April 2025 fertiggestellt werden, wie die EU-Kommission vor Inkrafttreten des Gesetzes mitteilte.

Bei Verstößen gegen die Auflagen, etwa dem Einsatz verbotener Technologie, drohen teils empfindliche Geldstrafen - bis zu 35 Millionen Euro oder bei Unternehmen bis zu sieben Prozent des weltweiten Jahresumsatzes des vorangegangenen Geschäftsjahres. Das genaue Strafmaß liegt in der Verantwortung der Mitgliedsstaaten.

Programmiertes Werte-Korsett

Der AI-Act wird durchaus auch kritisch gesehen. Die Bedenken gehen dabei in teils gegenläufige Richtungen. Während die einen in der Verordnung einen Vertrauen schaffenden und Rechtssicherheit stärkenden Schub für die weitere Entwicklung der Technologie sehen, fürchten andere eine Bremse für ebendiesen Sektor. Es wird also gleichzeitig die Stärkung und die Schwächung des Wirtschafsstandortes Europa herbeiargumentiert. In welche Richtung es hier geht, wird sich daran entscheiden, ob sich andere Märkte mit ihren künftigen KI-Reglementierungen an Europa orientieren.

Es ist im Interesse Europas, hier als Role-Model zu dienen und einen global tragfähigen Standard zu definieren. Nicht nur, um den Wirtschaftsstandort zu stärken und auf internationalen Märkten wettbewerbsfähig zu bleiben. Im AI-Act ist auch ein ethisches Wertekonzept enthalten. Orientieren sich auch andere Märkte an diesem digitalen Verhaltenskodex, stärkt das auch das europäische Verständnis von Demokratie, Pluralität und Menschenwürde. Dann könnten die nach dem AI-Act gezimmerten Anwendungen so etwas wie ein in Programme gegossenes ethisches Grundkorsett enthalten, zugespitzt könnte man sagen – eine neue künstliche Menschlichkeit prägen.

Zahme Hauskatze und galoppierender Gepard

Ein weitere Kritikpunkt setzt beim Faktor Zeit an. Es hat Jahre gedauert, um den AI-Act zu schmieden, jetzt dauert es wieder Jahre, bis er vollends umgesetzt ist. Die technische Entwicklung geht parallel dazu weiter, rasant sogar. Es besteht also die Gefahr, dass hier Regelungen für etwas erdacht wurden, das in zwei Jahren – oder schon früher – nicht mehr zeitgemäß ist. Dann würde man versuchen, mit dem Zaumzeug einer Hauskatze, einen galoppierenden Geparden zu zähmen, bemühen skeptische Stimmen einen Vergleich.

Ob ausreichend oder nicht: Dass es den KI-Act überhaupt gibt, ist ein Schritt in die richtige Richtung. Angesichts der rasanten Weiterentwicklung von Technologien gleich zu kapitulieren, ist keine Alternative. In der jetzigen Form der Verordnung steckt zumindest ein Hoffnungsschimmer: Dass nicht nur der Mensch immer technischer wird, sondern auch die Technik menschlicher.