Digitale Diagnosen: Wie Künstliche Intelligenz die Medizin verändert

Schriftgröße

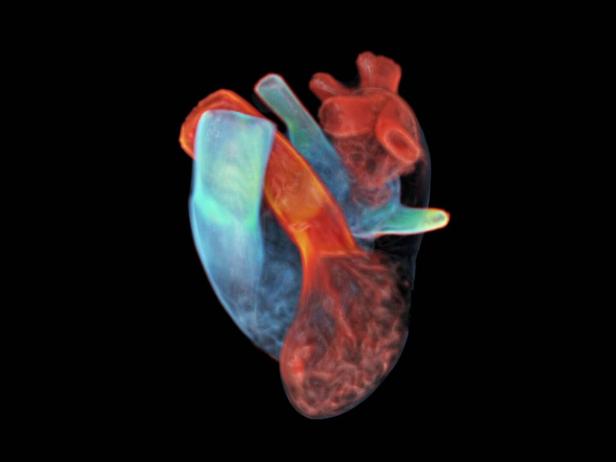

Ein Mausklick, und das Herz steht still. Das stete Pumpen erlischt, die rhythmischen Kontraktionen enden. Es ist zum Glück kein echtes Herz, das da plötzlich angehalten hat, sondern ein digital nachgebildetes, eine Simulation. Dorin Comaniciu betätigt die Maus erneut, und das virtuelle Organ beginnt wieder zu schlagen. Comaniciu zeigt auf seinem Laptop damit einen Ausblick auf die Medizin der Zukunft: Computertechnologie und künstliche Intelligenz erlauben es, auf Basis physiologischer Daten ein originalgetreues Gegenüber des menschlichen Körpers zu erzeugen, etwa des Herzens samt Klappen, Kammern und Blutgefäßen. Dieses Modell ermöglicht es unter anderem, medizinische Eingriffe durchzuspielen, bevor sie wirklich stattfinden – beispielsweise das kurzzeitige Stoppen des Herzens, wie es bei manchen Operationen notwendig ist.

Dorin Comaniciu ist Senior Vice President for Artificial Intelligence and Digital Innovation bei Siemens Healthineers, der Medizintechniksparte des Siemens-Konzerns. In einem Forschungszentrum in Princeton, New Jersey, arbeitet er an Entwicklungen für die Medizintechnik der Zukunft: an effizienter Bildgebung, Präzisionsmedizin, individualisierter, datengetriebener Diagnostik und Therapie. Der gebürtige Rumäne hält rund 270 Patente, war an 350 wissenschaftlichen Fachartikeln beteiligt, ist Mitglied mehrerer Medizinakademien und wird in Rankings unter die Top-Innovatoren der Gegenwart gereiht.

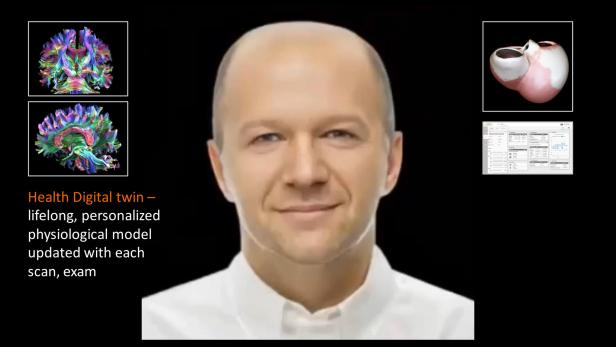

Auf seinem Laptop kann Comaniciu auch ein virtuelles Abbild seiner selbst aufrufen. „Fällt Ihnen etwas auf?“, fragt er. „Ich sehe hier jünger aus als in Wirklichkeit.“ Das sei Absicht. Es gehe aber nicht um Eitelkeit, sondern um einen Vorgeschmack auf eine Zukunft, in der uns eine fortgeschrittene Medizin vielleicht länger jung hält.

Was Comaniciu bei seinem Wien-Besuch vorführt, sind eine virtuelle Entsprechung eines echten Organs sowie ein computergenerierter Zwilling einer realen Person – und das ist auch der Fachbegriff dafür: Digital Twin. In verschiedenen Sparten der Wissenschaft und Industrie kommen solche Modelle längst zum Einsatz, um komplexe Abläufe zu testen. Ingenieure erproben damit Fertigungsschritte in Fabriken, prüfen Turbinen von Kraftwerken und kontrollieren Technik oder Bahnen von Flugzeugen und Raumfähren. In der Medizin, wo es stets um heikle Gesundheitsdaten, möglicherweise lebenswichtige Entscheidungen für konkrete Personen sowie um weitaus kompliziertere Zusammenhänge als in jeder Technologie geht, sind digitale Zwillinge noch im Versuchsstadium – und werden dennoch intensiv beforscht und gelten als wichtige Säule des künftigen Gesundheitswesens. Entsprechend intensiv wird das Konzept im Moment debattiert.

Eine Flut neuer Anwendungen

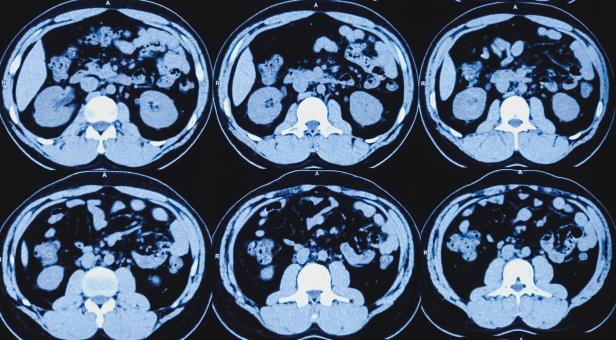

Der einzige Ansatz, um die Betreuung und Behandlung von Patienten mit digitaler Technologie und künstlicher Intelligenz (KI) zu bereichern, ist die Idee des Digital Twin keineswegs. Kaum eine Woche vergeht derzeit, in der nicht neue Anwendungen vorgestellt und Studien über deren Funktion und Erfolge publiziert werden. Besonders die medizinische Diagnostik scheint von KI zu profitieren: Trainiert mit Unmengen an Röntgen-, Ultraschall- oder Computertomografie-Aufnahmen sowie mit typischen Strukturen von Tumoren und anderen Plagen der Menschheit, begutachten Machine-Learning-Systeme Patientenbilder und suchen darin nach verdächtigen Mustern, die zum Beispiel auf Krebs hindeuten. Andere sind darauf spezialisiert, Daten zu erfassen und auszuwerten, deren Ausmaß die Kapazität des Menschen dramatisch übersteigen würde: etwa auf Genom-Analysen, auf die Suche nach neuen Medikamenten durch Abgleich von Millionen potenzieller Wirkstoffe oder die Dechiffrierung der 3D-Struktur Hunderter Millionen vormals unverstandener Proteine, die eminenten Einfluss auf Krankheiten haben könnten. Wieder andere Innovationen unterstützen Chirurgen bei der Operationsplanung oder nehmen Ärzten lästige Bürokratie und Dokumentationsarbeit ab.

Damit verbunden sind nicht nur Fragen der technischen Machbarkeit und Zuverlässigkeit, sondern auch ethische Erwägungen: Sind wir gerade im Begriff, Entscheidungen auf Maschinen abzuwälzen? Wer haftet für Fehler? Wollen wir, dass Artificial Intelligence unser Blutbild, unser Mammogramm, unsere Knochendichtewerte studiert und beurteilt? Sind wir willens, blutleeren Apparaten unsere persönlichsten Daten in den Rachen zu werfen? Und ist die Verheißung glaubwürdig, dass gerade der Einsatz von Maschinen Ärzten wieder mehr Zeit am Krankenbett schenkt, weil sie zeitraubende, monotone Arbeiten übernehmen? Oder ebnet KI erst recht den Weg in eine Ära noch krasserer Apparatemedizin?

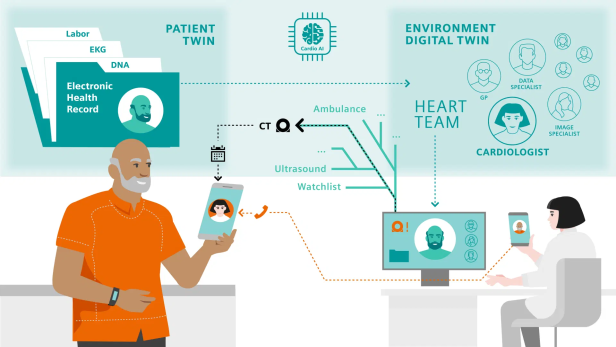

Wie auch immer die Antworten auf diese Fragen lauten: Sicher werden Artificial Intelligence und Machine Learning in die Medizin hineinwirken, und der Digitale Zwilling könnte eine Schnittstelle zwischen Ärzte- und Patientenschaft darstellen, eine Plattform, die kontinuierlich gemessene Vitalparameter, Diagnosen, Therapien und deren begleitende Prüfung vereint. „Die Idee des Patient Twinning besteht darin, ein digitales Modell zu erzeugen und mit dessen Hilfe die beste Therapie für eine individuelle Person auszuwählen“, sagt Comaniciu. Ein Positionspapier amerikanischer Gesundheitsbehörden zum Thema formulierte kürzlich folgende Definition: „Ein Digital Twin basiert auf Modellierung und Simulation, um eine virtuelle Repräsentation zu erschaffen, die ihr physisches Gegenstück nachbildet.“

Maschinen mit Herz

Der wichtigste Nährstoff eines Digitalen Zwillings sind Daten: Wir sammeln im Lauf des Lebens Blutbilder an, verschiedenste Laborwerte, EKG-Aufzeichnungen, Röntgen-, CT-, MR-Bilder und viele weitere Diagnosen. Mit diesen Befunden würde das Modell gespeist, in einer mehr oder minder nahen Zeit vielleicht vom Tag der Geburt an, sodass der Datenreichtum des Zwillings gleichsam mit uns mitwächst. Zusätzlich zu medizinischen Diagnosen könnten – neben Angaben über Alter, Größe, Gewicht und Lebensgewohnheiten – Messungen von „Smart Watches“ einfließen, die im Alltag etwa Herzfrequenz und Blutdruck erfassen. Anhand zahlreicher Bilder und Messwerte entsteht allmählich, Stück für Stück, das Modell wichtiger Körperfunktionen und Organe einer Person, zum Beispiel ein Abbild des Herzens – basierend eben nicht auf allgemeinen Daten über die Beschaffenheit eines Herzens, sondern auf den ganz konkreten des jeweiligen Menschen.

Der digitale Herzzwilling existiert bereits, nicht nur bei Siemens Healthineers, sondern zum Beispiel auch in Graz. Forschende der Technischen und der Medizinischen Universität Graz haben einen „CardioTwin“ entwickelt. Das Machine-Learning-System wurde zunächst mit einer Unzahl von Tomografiebildern der Herzanatomie trainiert. Auf dieser Basis lernte die KI im zweiten Schritt, aus Patientenbildern ein Modell eines individuellen Herzens zu erstellen – letztlich immer ein in seiner Größe und Form einzigartiges Organ, erst recht dann, wenn es von Erkrankungen betroffen ist.

An der Simulation weiterer Organe wie der Leber wird international gearbeitet, besonders komplex und daher noch Zukunftsmusik ist allerdings eine realitätsgetreue Nachbildung des Gehirns. Die Vision ist, eines Tages nicht nur virtuelle Entsprechungen einzelner Organe herstellen zu können, sondern diese digital auch miteinander zu vernetzen, um den lebenden Organismus zu simulieren. Hinzu kämen mit der Zeit Knochen, Blut-, Immun- und Nervensystem.

Und noch viele weitere Informationen können nützlich sein: „Wir besitzen rund 30 Billionen Körperzellen und noch viel mehr Mikroorganismen, die unser Mikrobiom bilden“, sagt Comaniciu. „Es ist faszinierend, wie all diese Zellen zusammenarbeiten und bewirken, dass unser Körper funktioniert.“ Je mehr Einsichten in diesem molekularen Reigen gewonnen werden, je umfassender zudem das Genom und der Einfluss der Gene und Proteine auf Krankheiten wie Krebs verstanden werden, desto mehr wächst auch der Wissensstock, der für einen Digital Twin nutzbar ist – und mit dem individuelle Patientendaten abgeglichen werden können.

Wir besitzen rund 30 Billionen Körperzellen und noch viel mehr Mikroorganismen, die unser Mikrobiom bilden. Es ist faszinierend, wie all diese Zellen zusammenarbeiten und bewirken, dass unser Körper funktioniert.

Dorin Comaniciu, Siemens Healthineers

Die Fragen könnten dann lauten: Welches Medikament in welcher Dosierung verspricht die besten Erfolge bei einer bestimmten Person, angepasst eventuell an dessen genetisches Profil? Es wäre die Umsetzung der Idee maßgeschneiderter Präzisionstherapie. Oder: Verraten Befunde Anzeichen von Krebs? Und wenn ja, welche Behandlung ist aufgrund der individuellen Gesundheitswerte am aussichtsreichsten? Im Grunde ließen sich sogar die Effekte einer Therapie vorab virtuell erproben, auf Basis eines virtuellen Modells des konkreten Tumors. Nach dem gleichen Prinzip könnte man testen, was sich in einem bestimmten Patientenherz nach Einsetzen eines Schrittmachers ereignet: Wie ändert sich der Blutfluss, wie der Druck? Es ließen sich gewissermaßen kontrollierte Experimente im digitalen Raum durchführen und auswerten, bevor man tatsächliche Eingriffe vornimmt.

Wollen wir wirklich so viel wissen?

Wo aber befindet sich ein Digitaler Zwilling überhaupt? Ist er in Form eines Programms abrufbar wie auf Comanicius Laptop? „Warum nicht?“, meint der Forscher. Eigentlich sei jedoch die Idee, dass die Ärzteschaft, entsprechend autorisiert, in Kliniken und Arztpraxen darauf zugreifen kann, um neue Befunde einzuspeisen, sie zu interpretieren und Behandlungen zu planen.

Nun könnte man die Frage stellen: Wollen wir das überhaupt? Wollen wir wirklich alles wissen, was solch ein System herauszufinden vermag, den Verdacht auf vielleicht in erst späten Lebensphasen auftretende Krankheiten eingeschlossen? Das seien individuelle Entscheidungen, meint Comaniciu, genau wie die Bereitschaft, solche Systeme mit Unmengen höchst privater Daten zu füttern. In Deutschland lehnte in Umfragen knapp ein Fünftel der Menschen die Idee eines Digital Twin grundsätzlich ab. „Und das sollten wir schlicht respektieren“, sagt Comaniciu.

Unstrittig ist freilich: Daten sind jener Rohstoff, den Artificial Intelligence benötigt, um Leistung zu erbringen – und viele Experimente zeigen mittlerweile, dass die Systeme bei der Analyse großer Datenmengen dem Menschen zumindest ebenbürtig sind und ihn bisweilen schlagen. Daher gilt als vorerst wichtigstes und dem Praxiseinsatz sehr nahes Anwendungsgebiet die Begutachtung von Patientenbefunden. Kein Radiologiekongress derzeit, bei dem nicht die neuesten Erfolge auf dem Gebiet präsentiert werden. Als im vergangenen März internationale Radiologen in Wien tagten, wurden Chancen der Früherkennung von Krankheiten debattiert. KI-Systeme scheinen in der Lage zu sein, anhand von Markern wie Knochendichte oder Blutwerten Prognosen über die Wahrscheinlichkeit von Knochenbrüchen oder Krebs zu erstellen, bevor eindeutige Spuren oder gar Symptome nachweisbar sind – was die Hoffnung nährt, Leiden präventiv behandeln zu können.

Erörtert wurde außerdem das Vorhaben eines EU-weiten Screenings von Risikogruppen auf frühe Hinweise auf Lungenkrebs: Die dabei anfallenden Datenmengen wären so enorm, dass sie Menschen kaum in akzeptabler Zeit sichten könnten.

Die Begrenztheit menschlicher Ressourcen gilt als eines der Hauptargumente für den Einsatz von KI – auch weil dank ausgereifterer Bildgebung durch Magnetresonanz- oder Kernspintomografie immer mehr MR-, CT- und weitere Befunde anfallen. Ein Stanford-Radiologe berichtete kürzlich, er finde in der Früh oft Aufnahmen von 150 Patienten auf seinem Schreibtisch vor, die er rasch bewerten müsse. Zeit und Konzentration des Menschen sind beschränkt. Studien zeigen, dass die Fehlerquote von Radiologen bei drei bis fünf Prozent liegt – pro Tag. Maschinen dagegen ermüden nie und screenen Tausende von Bildern in kürzester Zeit. Allein ein 24-Stunden-EEG kann fast 6000 Bildschirmseiten mit Resultaten produzieren. Die Auswertung wäre die klassische Aufgabe für Maschinengehirne.

Einst Brettspiele, nun Medizindiagnostik

Sie benutzen dabei eine Methode, die als „Deep Learning“ bekannt ist: Vor Jahren machten Entwicklungen Schlagzeilen, die die besten humanen Schach- oder Go-Spieler ausstachen. Die einst spielerischen Anwendungen erfüllen nun nach sehr ähnlichem Prinzip Jobs in kritischen Bereichen der Medizin. Für Brettspiele waren sie mit gigantischen Mengen von Spielzügen trainiert worden und lernten, indem sie gegen sich selbst spielten, die schlauesten Tricks und Kniffe. Für die Medizin üben die Systeme nicht mit Spielregeln, sondern mit CT- und MR-Bildern, mit Blutbefunden, Röntgen- und Ultraschallaufnahmen. Nach einer Unzahl von Trainingseinheiten entwickeln sie die Kompetenz, verdächtige Muster und Strukturen darauf zu entdecken – Indizien für Herzleiden und Schlaganfälle, für Krebs und Diabetes.

So unvorstellbar es einst schien, dass Schachweltmeister gegen Computer verlieren, so irritierend mag es einem vorkommen, dass Maschinen präzisere Diagnosen stellen als Menschen – und doch dürfte genau das der Fall sein. Schweizer Forschende haben eine KI entwickelt, die Herzultraschallbilder Neugeborener begutachtet und erstaunlich gut dabei abschneidet, angeborene Herzfehler zu erkennen. An der Medizinischen Universität Wien wurde ebenfalls ein KI-Tool kreiert, das bei der frühzeitigen Erkennung einer gravierenden Krankheit helfen soll: Kardiale Amyloidose entsteht durch fehlerhafte Proteine im Herzmuskel. Das seltene, aber schwere Leiden kann zu Herzinsuffizienz und zum Tod führen. Artificial Intelligence, trainiert mit Patientendaten von rund 16.000 Personen, soll die frühe Diagnose und Therapie verbessern, indem sie sogenannte Szintigrafie-Aufnahmen nach verdächtigen Signalen durchforstet.

Eine Forschergruppe aus China wiederum schulte eine KI mit 30.000 Bildern von Krebszellen und Diagnosedaten von 21.000 Patienten, um besonders tückische Krebszellen aufzuspüren: Diese „verstecken“ sich gleichsam im Körper und verraten ihren Ursprungsort nicht, was aber für die Therapie wichtig wäre. Oft werden sie erst erkannt, wenn sie bereits Metastasen bilden. Mithilfe der KI gelang es angeblich in mehr als 80 Prozent der Fälle, verdächtige Frühstadien von Krebs an der korrekten Stelle aufzuspüren.

Schlägt die Maschine den Menschen?

Was freilich zugleich bedeutet, dass ihre Diagnosen nicht zu 100 Prozent perfekt sind. Das sind jene des Menschen allerdings auch nicht. Im Vorjahr ließ eine US-Wissenschaftergruppe Mensch und Maschine gleichsam gegeneinander antreten und testete deren jeweilige Fehlerkompetenz. Zunächst wurden in 200 Patientenakten 150 Fehler eingebaut. Dann sollten sechs Radiologen sowie das Sprachprogramm ChatGPT-4 unter Beweis stellen, ob sie die Fehler bemerkten. Ergebnis: ChatGPT schnitt mit einer Trefferquote von knapp 83 Prozent etwas schlechter ab als erfahrene Radiologen (fast 90 Prozent), aber besser als Assistenzärzte (80 Prozent).

Allerdings würden seriöse Forschende auch niemals dafür plädieren, den Menschen durch KI zu ersetzen. Die Idee ist vielmehr, maschinelle Unterstützung zu erfahren, deren Ergebnisse letztlich von Menschen geprüft werden. Radiologen an der renommierten Johns Hopkins School of Medicine benutzen Artficial Intelligence als eine Art Zweitmeinung: Nach Durchsicht von Mammogrammen sucht zusätzlich eine KI nach verräterischen Spuren von Brustkrebs.

Andere Einsatzgebiete für Artificial Intelligence beziehen sich mehr auf Grundlagenforschung – und könnten dazu beitragen, manch ungehobenen Schatz für die Medizin zu beheben. Beispielsweise lassen sich riesige Wirkstoffdatenbanken mit Millionen von Einträgen systematisch durchsuchen. So könnten neue Wirkstoffe oder kluge Kombinationen daraus entdeckt werden, ohne neue Präparate aufwendig entwickeln zu müssen. Zugleich sind die Auslöser für viele Erkrankungen nicht oder nur unzulänglich verstanden. Ein digitales Monsterprojekt zielt darauf ab, das zu ändern: AlphaFold ist ein KI-System von Google, dessen Zweck die Entschlüsselung des Protein-Universums ist.

Proteine sind nichts anderes als Eiweißstoffe. Alles Leben besteht aus Proteinen, und viele Leiden beruhen auf deren Fehlfunktion. Um ihnen auf den Grund zu gehen, bedarf es der Kenntnis der Proteine und deren räumlicher Struktur. Wissenschafter in Labors waren einst glücklich, wenn sie ein paar Dutzend Proteine knackten, AlphaFold schaffte in kürzester Zeit einige 100 Millionen und platzierte deren 3D-Struktur in Internet-Datenbanken. Manche Forschende träumen schon davon, eines Tages das Reich der Proteine mit Wirkstoffdatenbanken abzugleichen und künstliche Intelligenzen neue Therapieansätze aufspüren zu lassen. Eine Prognose gab die Zahl möglicher Kombinationen mit fast 40 Milliarden an.

Und am Krankenbett, in der Pflege, bei der Betreuung immobiler Patienten? Sollten da nicht Roboter assistieren? Tatsächlich stellen Forschende auch dafür ständig Innovationen vor, so erst vor wenigen Tagen das AIT Austrian Institute of Technology zusammen mit schottischen Experten. Ein Assistenzroboter soll nach Schlaganfällen halbseitig gelähmte Menschen bei der Rehabilitation unterstützen, gleichzeitig zeichnen Sensoren Gehirnströme der Patienten auf.

Menschliche Qualitäten traut man all den Maschinen und künstlichen Intelligenzen im Regelfall eher nicht zu – und dafür sind sie ja im Grunde auch nicht gedacht, vielmehr sollen sie ärztlichem Personal mehr Raum für intensiveren Patientenaustausch gewähren. Doch es gibt Überraschungen: In einer Londoner Klinik wurde testhalber der Einsatz eines Sprachsystems namens „Amie“ geprobt, das ähnlich wie ChatGPT funktioniert. Die Probanden, die nicht wussten, ob sich ein Mensch oder eine Maschine mit ihnen unterhielt, gaben dem Sprachroboter durchwegs Bestnoten – bei der Diagnosestellung anhand von Patientengeschichten, aber auch hinsichtlich Empathie, Höflichkeit und allgemeiner Gesprächsqualität.

Mitunter können Maschinen offenbar ziemlich menschlich sein.

Alwin Schönberger

Ressortleitung Wissenschaft